Google’ın Yeni Yapay Zeka Algoritması TurboQuant ile Bellek Performansı Artıyor

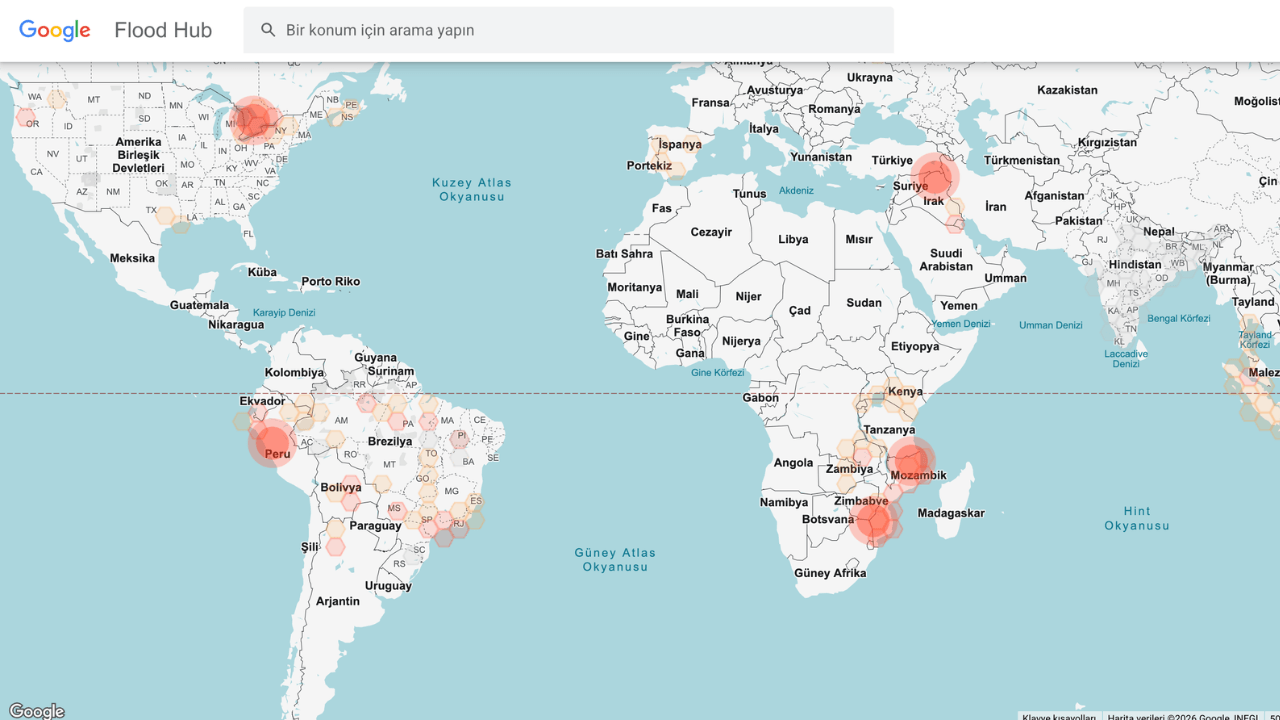

Google, yapay zeka teknolojileri alanında çığır açan bir gelişmeye imza attı. Şirket, yeni bellek sıkıştırma algoritması TurboQuant‘ı resmi olarak duyurdu. Google Research, bu yeniliği, yapay zekanın çalışma belleğini küçültmenin etkili bir yolu olarak tanımlıyor. Özellikle Büyük Dil Modelleri (LLM’ler) gibi karmaşık sistemler için geliştirilen bu algoritma, performansı etkilemeden daha az bellek kullanımı sağlıyor.

TurboQuant ve Bellek Sıkıştırma Performansı

Günümüzde, LLM’ler devasa belgeleri ve karmaşık konuşmaları işlemek için çok geniş bağlam pencerelerine ihtiyaç duyuyor. Bu durum, Anahtar-Değer (KV) önbellek darboğazını gündeme getiriyor. Modelin işlediği her kelime, yüksek hızlı bellekte yüksek boyutlu bir vektör olarak depolanıyor. Uzun süreli görevler sırasında bu dijital bilgi hızla büyüyor ve GPU ile VRAM sistemleri büyük ölçüde etkileniyor. Sonuç olarak, zamanla modelin performansında kayıplar gözlemleniyor.

TurboQuant, bu sorunu aşmak için matematiksel bir şablon sunarak KV önbellek sıkıştırmasını sağlıyor. Araştırmalar, bu algoritmanın belirli bir modelin kullandığı KV bellek miktarını ortalama 6 kat azalttığını ve dikkat logitlerinin hesaplanmasında 8 kat performans artışı sağladığını gösteriyor. Dolayısıyla, bu teknolojiyi kullanmaya başlayan işletmeler, maliyetlerini yüzde 50’den fazla düşürebilecek.

Topluluk ve Uygulama Gelişmeleri

Google Research’ün bu duyurusu, yayımlandığı ilk 24 saat içinde 7,7 milyondan fazla görüntüleme aldı. Topluluk üyeleri, TurboQuant algoritmasını Apple Silicon için MLX ve llama.cpp gibi popüler yapay zeka kütüphanelerine entegre etmeye başladı. Örneğin, teknik analist Prince Canuma, X platformunda yaptığı paylaşımda Qwen3.5-35B modelini test etmek için TurboQuant’ı MLX’te uyguladığını açıkladı. Canuma, bu süreçte 8,5K ile 64K token arasında %100 tam eşleşme elde ettiğini belirtti.

Canuma’nın deneyimlerine göre, 2,5 bitlik TurboQuant, doğruluk kaybı olmadan KV önbelleğini neredeyse 5 kat oranında azalttı. Bu durumda, TurboQuant’ın sağladığı avantajlar yalnızca teknik anlamda değil, aynı zamanda ekonomik açıdan da önemli bir fırsat sunuyor.

Gelecek Vizyonu ve Araştırmalar

Google araştırmacıları, TurboQuant’ı geliştirmek için 2024’te başlayacak bir araştırma sürecini tamamladı. Bu süreç, yıllar süren çalışmaların bir sonucudur. Araştırmacılar, TurboQuant’ın ardından PolarQuant ve Quantized Johnson-Lindenstrauss (QJL) gibi diğer matematiksel framework’leri de ele almayı planlıyor. Ayrıca, TurboQuant, halüsinasyonlara neden olan nicelleştirme hatalarını aşmak için bu framework’lerden faydalanıyor.

TurboQuant’ın resmi tanıtımı, akademik teorilerden büyük ölçekli üretime geçişin bir işareti olarak değerlendiriliyor. Teorik temelli algoritmalar ve bu konudaki araştırma makaleleri, şu anda kullanıcılar için ücretsiz olarak sunuluyor. Kurumsal kullanım imkanı da mevcut.

Kaynak: Webrazzi