Daha büyük model değil, daha akıllı mimari: Recursive Language Models (RLM) ne vadediyor?

Büyük dil modelleri (LLM) son yıllarda bağlam pencerelerini hızla büyütse de, çok uzun ve karmaşık metinlerde yaşanan performans kaybı ciddi bir sorun olmayı sürdürüyor. “Context rot” olarak adlandırılan ve “bağlam çürümesi” olarak tercüme edilebilen bu problem, modele ne kadar fazla metin verilirse verilsin, bilginin etkili şekilde kullanılamamasına yol açabiliyor.

Son dönemde araştırma dünyasında dikkat çeken Recursive Language Models (RLM) yaklaşımı ise bu soruna farklı bir yerden yaklaşıyor: bağlamı büyütmek yerine, bağlamın nasıl yönetildiğini değiştirmek.

Recursive Language Models (RLM) nedir?

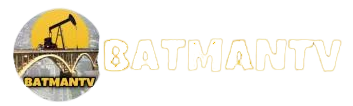

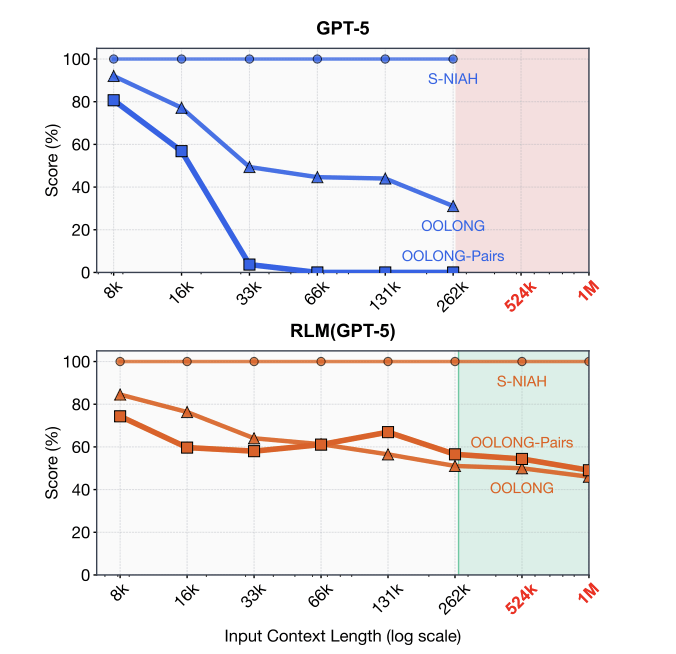

MIT’li araştırmacılar Alex L. Zhang, Tim Kraska ve Omar Khattab tarafından ortaya konulan Recursive Language Models (RLM), klasik anlamda yeni bir yapay zeka modeli değil. RLM, mevcut dil modellerinin, çıkarım (inference) sürecinde kendilerini tekrar tekrar çağırabildiği, bilgiyi ise modelin dışında tutulan harici bir bellek üzerinden parça parça işlediği bir mimari yaklaşımı temsil ediyor. Makalede yer alan deneysel sonuçlar, klasik LLM’lerin bağlam uzadıkça performans kaybı yaşadığını, RLM yaklaşımının ise daha istikrarlı bir performans sergilediğini gösteriyor.

Bu sistemde uzun dokümanlar doğrudan modele yüklenmiyor. Metinler, bir değişken veya veri yapısı olarak konumlandırılabilecek harici bir ortamda tutuluyor. Model, ihtiyaç duyduğu bölümleri küçük alt görevler halinde çağırıyor. Bu alt görevlerden elde edilen ara sonuçlar birleştirilerek nihai çıktı oluşturuluyor.

Bu sayede model, tüm metni aynı anda “aklında tutmaya” çalışmak yerine, gerektiğinde geri dönüp bakabilen bir yapıya kavuşuyor. Kısacası model, harici ortamda tutulan metni incelemek için kod yazabiliyor, filtreleme veya parça çıkarma işlemleri yapabiliyor ve gerektiğinde kendisini alt görevler için tekrar çağırabiliyor.

RLM yaklaşımı yalnızca bağlamı genişletmeye odaklanmıyor. Araştırmacıların vurguladığı bir diğer önemli nokta, çıkarım sürecinde (inference-time) hesaplama gücünün daha akıllı kullanılması. Model, tüm bağlamı tek seferde işlemeye çalışmak yerine, görevleri parçalara ayırarak programatik şekilde ilerliyor. Bu yaklaşım, “daha büyük model” yerine “daha iyi organize edilmiş çıkarım süreci” fikrine dayanıyor.

Agentic AI ve kurumsal kullanım odağında RLM

RLM, giderek popülerleşen Agentic AI ve kurumsal kullanım senaryolarında tercih edilebilir. Recursive Language Models yaklaşımı özellikle hukuk ve finans gibi çok uzun dokümanlarla çalışılan alanlarda önemli avantajlar sunabilir. Bununla beraber büyük kod tabanlarının analizinde verimlilik sağlayabileceği gibi kurumsal bilgi yönetimi ve iç dokümantasyon sistemlerinde de RLM’den faydalanılabilir. Ayrıca RLM’in uzun süreli ve çok adımlı görevleri yerine getiren yapay zeka ajanlarında

da dikkate değer fayda sağlayacağını söyleyebiliriz. Bu bağlamda RLM mimarisinin agentic AI kavramıyla da doğal bir uyum gösterdiğini belirtelim. Çünkü RLM’lerde bellek yönetimi, araç çağırma ve çok adımlı karar alma süreçleri zaten sistemin temel parçası hâline geliyor.

Bu bağlamda Recursive Language Models yaklaşımının yalnızca teorik bir çerçeve olmadığı da görülüyor. Google Developer forumunda paylaşılan bir örnekte, RLM mantığının Agent Development Kit (ADK) içinde nasıl kurgulanabileceği anlatılıyor. Bu yapıda uzun metinler veya veri kümeleri doğrudan modele yüklenmek yerine, “context” adı verilen harici bir değişken içinde tutuluyor. Model ise bu bağlam üzerinde programatik işlemler gerçekleştirebiliyor; örneğin belirli ifadeleri filtreleyebiliyor, sayım yapabiliyor ya da alt ajanları çağırarak görevi parçalara ayırabiliyor.

Bu yaklaşım, RLM’nin temel fikrini pratik bir çerçeveye oturtuyor: model yalnızca metni okumuyor, aynı zamanda metin üzerinde işlem yapan bir sistemin parçası haline geliyor. Böylece uzun bağlam problemi, yalnızca token penceresi meselesi olmaktan çıkıp, programatik bir yönetim problemine dönüşüyor.

Öte yandan RLM’lerin zorlukları da mevcut. Harici bellek kullanımı, çoklu çağrı yapısı ve alt görevlerin yönetimi, sistem mimarisini ciddi biçimde karmaşık hale getiriyor. Ayrıca gerçek zamanlı kullanım senaryolarında gecikme (latency) riski de söz konusu olabiliyor.

Yaklaşım, modelin muhakeme kapasitesini artırmaktan çok, mevcut kapasitenin daha düzenli ve kontrollü kullanılmasını sağlıyor. Bu da temel modelin kalitesinin hala belirleyici olduğu anlamına geliyor. Kısacası RLM’ler bir modeli “daha zeki” hale getirmiyor.

Recursive Language Models’in gördüğü ilgi, ekiplerin artık daha büyük modeller yerine, daha akıllı sistem tasarımlarına yönelebileceğini gösteriyor. Şimdiye kadar sistemlerde belge çağırma söz konusu olduğunda Retrieval-Augmented Generation (RAG) ile ilerlendiğini gördük. Geliştiricilerden bazıları RLM’in devreye alınmasıyla RAG devrinin kapanıp kapanmayacağını sorguluyor. Zira RAG, doğru bilgiyi bulma konusunda güçlü bir yöntem sunarken, birden fazla belgeyi karşılaştırma, uzun zincirli muhakeme gerektiren analizler veya çok adımlı planlama görevlerinde sınırlı kalabiliyor. RLM ise yalnızca bilgi getirmekle kalmayıp, getirilen bilginin nasıl işleneceğini de sistematik biçimde yönetmeye çalışıyor. Bu da ekipleri, RAG,

Agent ve RLM’in birlikte kullanıldığı bir yapıyla ilerlemeye teşvik ediyor.

Recursive Language Models’in gördüğü ilgi, yapay zeka dünyasında yeni bir yönelime işaret ediyor. Son yıllarda yarış, daha büyük parametreli modeller etrafında şekillenirken, RLM gibi yaklaşımlar odağı sistem mimarisine kaydırıyor. Önümüzdeki dönemde, tek başına daha büyük modeller yerine, RAG, agent mimarileri ve RLM benzeri çıkarım stratejilerinin birlikte kullanıldığı hibrit sistemlerin daha yaygın hale gelmesi olası.